A ideia de uma possível terceira guerra mundial assombrou as redes sociais nos primeiros dias de 2020. Entre memes e posicionamentos políticos, muito se falava sobre as tensões entre Estados Unidos e Irã, aquecidas após o exército americano bombardear o país rival em operação que matou o general Qasem Soleimani no dia 3 de janeiro.

No Twitter americano, a hashtag #IranDetestsSoleimani (#OIrãDetestaSoleimani, em tradução livre) chegou aos assuntos mais comentados, ou Trending Topics, nos dias seguintes ao bombardeio. Nas ruas de Teerã, no entanto, se mostrava o contrário – milhares de pessoas se reuniram para o funeral do general em lamentações.

Parte da explicação por trás dessa contradição já havia sido apontada em 2019 pelo analista Geoff Golberg: contas falsas de Twitter estavam espalhando uma narrativa pró-guerra contra o Irã .

Em janeiro do ano passado, o pesquisador encontrou uma série de perfis falsos e com evidências de automatização que estavam se engajando com a hashtag #WeSupportPolandSummit (#NósApoiamosAConferênciaDaPolônia), em apoio à reunião chefiada pelos Estados Unidos sobre conflitos no Oriente Médio, vista com maus olhos pelo Irã. O padrão se repetiu em outras tags. “Parecia que havia entidades que tentavam amplificar seus discursos através de contas falsas.”

Investigando mais, Golberg descobriu que entre esses perfis estava a conta do “Iran Disinformation Project”, um projeto financiado pelo Departamento de Estado Americano para combater desinformação no contexto da guerra contra o Irã. A conta se engajou em ataques contra jornalistas e pesquisadores e tinha conexões com grupos iranianos antirregime.

Golberg foi um dos perseguidos, mas não pretende se calar. Em julho de 2019 teve sua conta suspensa no Twitter após ser denunciado em massa. “A maneira que eles [os perfis falsos] silenciam as pessoas é a mesma que eles usam para manipular hashtags.”

A Agência Pública conversou com o CEO da Social Forensics, empresa de análise de redes sociais, sobre seus dados, os ataques sofridos e soluções para combater a manipulação do debate público no Twitter.

Em outubro do ano passado, você publicou um texto que mostra relações entre o Departamento de Estado americano e contas inautênticas no Twitter que manipulavam o debate na rede social, criando um clima pró-guerra e antirregime. Como você percebeu que havia essa manipulação?

Para explicar, eu vou voltar a janeiro de 2019, quando tropecei nesse assunto. Eu não sou um grande conhecedor de política. Essa nunca foi uma área em que eu tive muito interesse.

Inicialmente eu abri minha empresa, Social Forensics, para trabalhar com segmentação de audiências nas redes sociais para ajudar agências ou marcas a investir melhor em marketing de influenciadores. Ter um grande número de seguidores no Instagram ou outras redes pode render muito dinheiro com acordos de marcas, mas isso criou um ambiente no qual se tornou fácil comprar seguidores falsos. Isso tudo é muito fácil de manipular. Então, com a minha empresa, eu pretendia olhar para esses números de seguidores e seguidos e mapear com algoritmos as redes de segmentação, identificando falsos seguidores.

Mas em janeiro de 2019 eu fui pesquisar a hashtag #WeSupportPolandSummit e descobri que havia muitas contas se engajando na tag que não pareciam ser autênticas. Elas tuitavam centenas de vezes por dia e muitas tinham sido criadas recentemente.

Então eu compartilhei esses dados no Twitter em uma thread e a postagem decolou. Eu tive muitos retuítes, curtidas e comentários, entre eles de contas que não pareciam autênticas, que diziam ter se engajado na tag e que eram, sim, reais.

Resumidamente, eu analisei outras quatro ou cinco hashtags parecidas e foquei em como as contas interagiam umas com as outras. Vi os retuítes, as respostas, esse tipo de coisa. E eu percebi que muitas das mesmas contas apareciam nessas várias hashtags. E isso não é suspeito por si só, porque pode haver pessoas reais apoiando essas causas. Mas somando isso a outros fatores, como o alto volume de postagens, as coisas começam a ficar mais suspeitas.

E desde a primeira vez que eu compartilhei esses fatores suspeitos, como eu disse, contas falsas vieram tentar desmerecer meu trabalho. Outras contas não eram falsas, mas tinham muitos retuítes e curtidas de contas que pareciam inautênticas. Parecia que havia entidades que tentavam amplificar seus discursos através de contas falsas.

E qual era a relação dessas redes com o governo americano?

Uma das contas que se engajou na hashtag e que tinha postagens amplificadas por contas falsas era do perfil do projeto Iran Disinformation. Eu não sabia muito sobre ele, mas em maio alguns jornalistas começaram a compartilhar informações sobre esse projeto e suas conexões com o governo americano. O Iran Disinformation recebeu financiamento do Departamento de Estado americano, o que significa que dinheiro do governo dos EUA foi usado para manipular o debate no Twitter e trolar pessoas.

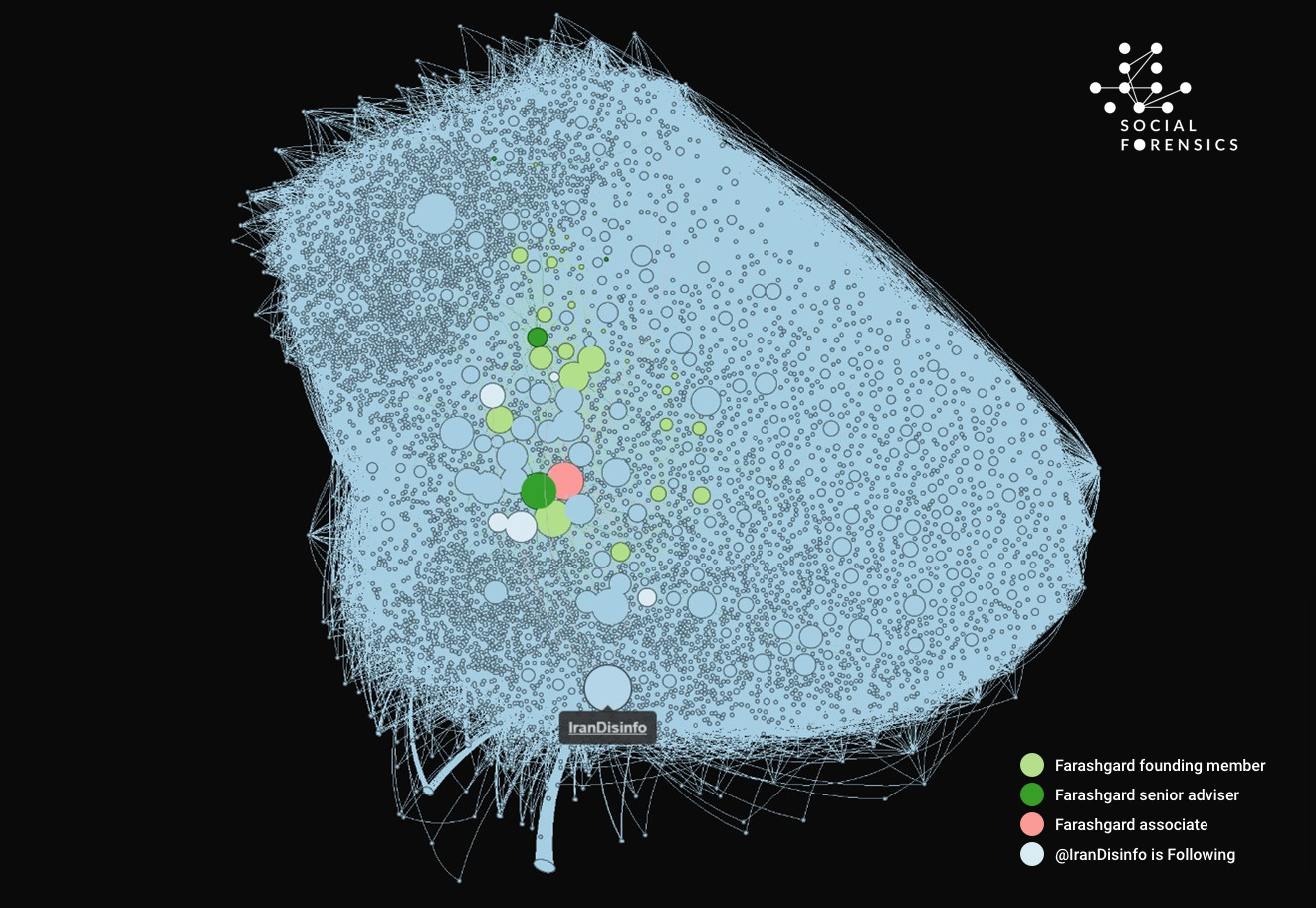

Então eu fiz uma análise baseada nas conexões de seguidores e seguidos relacionadas a essa Iran Disinformation e descobri que a conta tinha uma relação muito próxima a um grupo antirregime iraniano chamado Farashgard.

Separadamente, eu também encontrei uma conta chamada Heshmat Alani, que o Intercept investigou e mostrou que era falsa. E políticos americanos usavam tuítes desse perfil para embasar suas opiniões e políticas. Essa conta estava alinhada a outro grupo antirregime chamado Organização dos Mujahidin do Povo Iraniano, ou MEK. O Twitter suspendeu a conta, mas uma semana depois ela ressurgiu.

Outro grupo com o qual eu cruzei durante as análises foi a Fundação para Defesa de Democracias, FDD, e também uma organização chamada Tavaana.

Baseado nos tuítes que eu analisei, eles estavam todos conectados.

Havia suspeitas de que a coordenadora do Tavaana fora responsável por ligar o Departamento de Estado dos EUA ao Iran Disinformation. Eu não posso provar isso, mas alguns jornalistas disseram ter fontes de que ela estava envolvida.

E o Iran Disinformation retuitava frequentemente postagens de uma pessoa chamada Saeed Ghasseminejad, um dos conselheiros da FDD.

Então eu não posso dizer que o Departamento de Estado estava tendo conversas com grupos antirregime como o MEK e o Farashgard – e esses dois grupos são conhecidos por se engajar em guerra informacional no Twitter usando contas falsas e diversas estratégias de manipulação –, mas eu estou dizendo que essas contas estavam muito conectadas ao projeto Iran Disinformation.

Depois que essas relações entre o Iran Disinformation e grupos antirregime foram expostas, como o governo reagiu?

O financiamento ao projeto supostamente foi suspenso. Mas parecia que o Departamento de Estado não queria falar muito sobre isso. A questão é: se não houvesse denúncia de jornalistas e pesquisadores, isso teria acontecido? Provavelmente não.

É muito ruim que seja necessária a denúncia para que isso deixe de acontecer.

E até onde eu sei o financiamento foi suspenso em maio, mas a conta do Iran Disinformation no Twitter continua lá, sem atividade. Ainda assim não foi suspensa pelo Twitter ou excluída. Não sei por quê. A maioria de seus seguidores são inautênticos, falsos, e toda vez que a conta tuitava era amplificada por eles. Claramente havia uma coordenação envolvida e o fato de o Twitter não remover a conta, apesar de o Departamento de Estado cortar os fundos, não faz sentido para mim.

E quantos perfis você encontrou nessa rede?

É difícil responder isso porque havia contas reais que não faziam parte da coordenação. O gráfico que eu fiz foi para achar as contas que estavam mais ligadas ao Iran Disinformation, e então esbarrei em outros grupos que também estavam amplificando a narrativa pró-guerra.

Mas de maneira geral eu diria que eram mais de 20 mil contas inautênticas que estavam envolvidas.

E nem todas elas eram ativas, porque muitas delas eram usadas para inflar o número de seguidores e para dar mais autoridade à rede. Algumas nunca nem tuitaram.

E eu não diria que eram contas robôs, porque ser um robô significa ser automatizado. Um dos principais critérios que usamos para identificar automações é o alto volume de publicações, ou tuítes. Mas na realidade esse alto volume pode ser feito por um ser humano, muitas vezes. E, quando falamos em robôs, falamos sobre uma automação completa, 100%.

O tipo de contas inautênticas que nós encontramos é o que eu chamo de ciborgues, contas que são parcialmente automatizadas e parcialmente controladas por uma pessoa real. Muitas vezes vemos no Twitter contas que são claramente automatizadas, mas por vezes respondem a comentários ou reagem a postagens. Então é problemático quando as pessoas usam o termo “robô” sem filtro. É importante ser preciso com as palavras.

Nesse caso [da guerra virtual EUA contra Irã], nem todas as contas eram robôs, porque não eram completamente automatizadas. Há pessoas por trás. Analisando o comportamento dessas contas, eu prefiro classificá-las como ciborgues ou trolls.

E como funcionava a estratégia dessa rede de perfis para espalhar a narrativa pró-regime?

A maneira mais fácil de descrever essa estratégia é o termo astroturfing, que envolve qualquer maneira de distorcer um debate. Nesse contexto de redes sociais, o que o astroturfing faz é criar uma série de contas falsas ou personas que parecem apoiar uma causa. Então uma grande quantidade de contas no Twitter enche os tuítes de Trump ou de outros políticos com pedidos de bombardeio contra o Irã, por exemplo.

E, se uma série de contas no Twitter interagem com certo assunto, ao longo do tempo nem sempre fica claro que se trata de uma manipulação e assim a cobertura jornalística pode ser afetada. O que o astroturfing faz é usar as redes sociais para criar uma ilusão de suporte.

Você diz que tudo começou por causa da #WeSupportPolandSummit. Esse grupos se engajaram em mais hashtags? Isso é uma das estratégias do astroturfing?

Sim. A #WeSupportPolandSummit ficou entre os assuntos mais comentados do Twitter, ou Trending Topics. A #IranDetestsSoleimani também. Os Trending Topics são um verdadeiro Oscar para as pessoas envolvidas com poluição informacional. É um ranking valioso porque é visto por todas as pessoas, não apenas os seguidores. Assim, ele tem um impacto no debate público. Realmente tem.

Você mencionou que sofreu retaliações após publicar dados sobre a tag. Isso também é uma estratégia da rede?

Sim. Eu recebi ameaças de morte através do Twitter e eu denunciei para a plataforma, mas depois de um tempo até parei de reportar porque eu recebia uma resposta automática que dizia não ver problema nas publicações. Parece que eles não possuem uma equipe para tomar essas decisões, e eu não conheço o processo deles, mas eu sei que parece automatizado baseado nas respostas que eu tive.

É frustrante e eu não sou o único que passou por isso. Isso acontece com jornalistas, com pesquisadores e está sendo usado por agentes mal-intencionados para intimidar.

Eles querem que pessoas como eu parem de compartilhar informações que os ameaçam.

Algumas pessoas, inclusive, fazem seus trabalhos de denúncia sem usar seus nomes reais, através de contas pseudônimas.

Eu reconheço que me coloco em perigo ao usar meu nome verdadeiro, mas eu acredito que o público confia mais em informações que vêm de fontes conhecidas e a imprensa também dá menos cobertura quando não há um rosto.

Assim, a intimidação funciona para alguns, mas para mim não. Isso não vai me impedir de compartilhar as informações que eu tenho. Já divulgaram meu número de telefone, da minha família. Eu fui exposto e eu denunciei, mas precisou que toda uma comunidade de pessoas denunciassem também para que o conteúdo fosse excluído. E ainda demorou mais de dez horas.

Eles estão tentando intimidar, e essa é a técnica que eles usam. Por sorte eu não sou mulher ou de alguma minoria social, porque eu não consigo nem imaginar o nível de assédio e abuso que esses grupos sofrem nas redes. É realmente insano.

E você acredita que essa técnica de intimidação tem sido eficiente para certos grupos?

Não posso responder com certeza, mas acho que sim.

A maneira como eles silenciam as pessoas é a mesma que eles usam para manipular hashtags. Eles sabem jogar esse jogo e manipulam também o sistema de denúncias do Twitter.

Eu não parei de postar com as ameaças, mas comecei a ter meus tuítes denunciados. Eu sempre usei o Twitter, mas só depois que eu denunciei contas relacionadas à manipulação antirregime que eu tive minha conta penalizada.

Quando eu analisei a manipulação sobre criptomoedas e outras coisas, eu sofri ataques, mas não com tanta velocidade ou tanta técnica do que quando falei da questão da guerra contra o Irã. Eles conhecem melhor as ferramentas do Twitter.

Eles me denunciaram por usar a palavra “idiota” em um tuíte e a plataforma suspendeu minha conta temporariamente. Da primeira vez, por três horas. Depois foi aumentando. E isso aconteceu bem na época em que eu estava compartilhando informações importantes. Então eles realmente conseguiram me calar. E quando eu tentei falar com o Twitter eu não tive resposta. A combinação de fatores fez minha conta ser permanentemente suspensa, e eu não consigo recorrer à plataforma. Na minha perspectiva, o Twitter me censurou ao permitir que isso acontecesse, e eles não me querem na plataforma porque têm medo das informações que eu tenho para distribuir.

Você acredita que a plataforma se beneficia dessa atividade inautêntica que acontece lá?

Eu não estou dizendo que o Twitter se beneficia em permitir que agentes manipuladores consigam reportar e suspender contas reais. O que eu estou dizendo é que a plataforma permite que essas contas existam para que possam dizer que têm mais usuários que realmente têm aos investidores da bolsa de valores. Então tem muito pouco esforço para parar essa manipulação.

Se não podemos confiar no Twitter para suspender essas contas, como podemos lutar contra essa manipulação?

Acho que a longo prazo as pessoas vão ficar tão frustradas que vão começar a sair do Twitter, e aí talvez a plataforma comece a se preocupar mais.

Mas o problema é que não há alternativa ao Twitter. Eles possuem esse monopólio, ou uma enorme vantagem competitiva que não permite que surja outra plataforma nessa escala.

Então o que as pessoas podem fazer agora é não interagir com contas falsas e trolls. Especialmente se forem contas verificadas, porque o Twitter usa essas interações para determinar a autenticidade das contas e dar mais exposição a elas.

Então, antes de responder direto, verifique as contas. Olhe seus seguidos e seguidores, número de tuítes, data de criação, foto e descrição.

E você acredita que esses grupos têm sucesso em espalhar suas narrativas?

Claro. No caso das hashtags que chegaram aos Trending Topics, como a #WeSupportPolandSummit, eu acredito que elas tenham sido destacadas por alguns veículos jornalísticos, sem levar em conta que foram manipuladas. Outro exemplo é Mark Dubowitz, o CEO da FDD, que esteve em diversos jornais para comentar a situação iraniana. Ele teve muitos tuítes amplificados por contas falsas dessa rede. Então talvez ele tenha recebido mais destaque do que realmente merecia. A verdade é que todos os assuntos podem ser manipulados. O que é real no Twitter? Não sabemos. Não podemos confiar na maioria das coisas que vemos na plataforma.

E o grande problema disso é que é difícil para as pessoas entender essa manipulação.

Então é difícil dizer que depois de serem expostas ao Twitter as pessoas são influenciadas a serem favoráveis à guerra contra o Irã, ou contra o regime iraniano. Mas o que podemos provar é que hashtags fabricadas chegam à mídia tradicional e isso já é problemático.

E quão importante isso é para um contexto de guerra?

Pode ser considerado uma arma. É claramente muito importante. Se você pensar em como o Trump usou o Twitter para se posicionar sobre a situação iraniana e até para ameaçar bombardeios. Ele sabe que precisa estar à frente na narrativa num contexto bélico e as redes sociais permitem que isso aconteça. O Twitter ama isso. E é por isso que a plataforma não remove o Trump, apesar de ele violar algumas das regras, com xingamentos e ameaças. O Twitter depende do Trump. Muitas pessoas não eram interessadas na rede social antes dele e criaram contas para poder saber o que ele diz em primeira mão.

É bom que não dependamos da mídia tradicional para saber o que o presidente fala, mas é ruim que as plataformas sejam manipuláveis.

Você encontra o post Geoff Golberg: “Dinheiro do governo dos EUA foi usado para manipular o debate no Twitter” diretamente na fonte Agência Pública